¿Qué puede suceder con la inflación? por Dr. Ed Yardeni

El Dr. Ed Yardeni es una de las principales voces de LinkedIn en economía y finanzas. Colaborador habitual de los principales medios internacionales, actualmente dirige Yardeni Research una firma de consultoría que ofrece estrategias de inversión global, análisis y recomendaciones a clientes institucionales. Es autor de los libros «Predicting the Markets: A Professional Autobiography» y «Fed Watching for Fun & Profit”.

Dr. Ed Yardeni

/ Yardeni Research

La mayoría de los economistas, incluidos Debbie y yo, creemos que si los datos no respaldan nuestros pronósticos, entonces debe haber algo mal en ellos y que serán revisados para demostrar que, después de todo, teníamos razón. La mayoría de los economistas, incluido un servidor, también suelen descartar componentes de los indicadores principales que no respaldan nuestra historia y miran los indicadores «básicos» restantes para comprobar que se ajustan a nuestra perspectiva y, por lo tanto, la confirman.

Este enfoque de corte de los principales indicadores económicos suele ser lo que sucede cuando se publica el informe mensual de empleo. Se piensa que si los datos desestacionalizados no respaldan la narrativa, tal vez los datos no desestacionalizados sí lo hagan. O tal vez las revisiones de los datos de los meses anteriores apunten en la dirección “correcta” y, por lo tanto, sean lo que se debe destacar. Si la medida del empleo de las nóminas no es tan amigable como la medida de los hogares, concéntrese en la de los hogares.

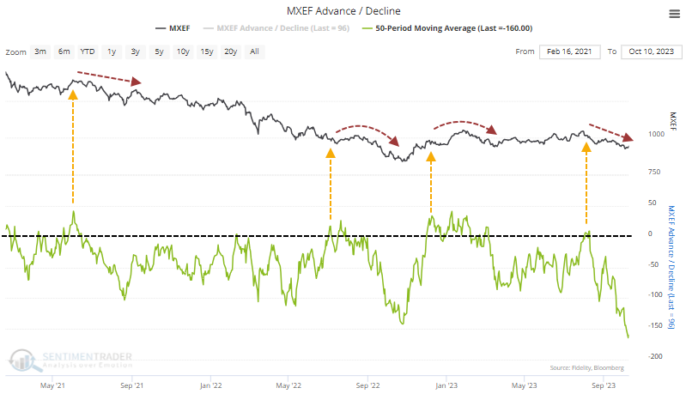

Otro indicador económico importante que invariablemente es desmenuzado por la hermandad de economistas es el IPC. El número de septiembre se publicó junto con todos sus componentes la semana pasada el jueves. Algunos economistas (como nosotros) afirmamos que esto confirma que la inflación todavía se está moderando y está resultando ser relativamente transitoria. Otros examinaron el informe y concluyeron que la inflación se está estancando a un ritmo muy superior al objetivo de inflación del 2,0% de la Reserva Federal. Algunos economistas encontraron evidencia de que la inflación puede estar acelerándose nuevamente, por lo que sigue siendo un problema persistente.

Entonces ¿quién tiene razón? Todos tenemos razón siempre porque hay muchos datos que respaldan todas nuestras historias. Los datos no conformes se descartan como estimaciones preliminares que sin duda serán revisadas o simplemente son erróneas. Sin duda, las revisiones futuras demostrarán que, después de todo, estamos en el camino correcto; si no, datos diferentes lo harán. Puede que no todos seamos keynesianos ¡pero todos somos profetas según los datos que elegimos para respaldar nuestra perspectiva!

Ahora analicemos el último IPC y veamos qué queda:

(1) Ignore el titular. No preste atención a la tasa de inflación general. Ese fue uno de los mensajes del discurso pronunciado por el presidente de la Reserva Federal, Jerome Powell, en Jackson Hole el 25 de agosto. Desde el principio, dijo que “los precios de los alimentos y la energía están influenciados por factores globales que siguen siendo volátiles y pueden proporcionar una señal engañosa de hacia dónde se dirige la inflación”. Así que centró su análisis en la tasa de inflación subyacente, es decir, la tasa general menos energía y alimentos. Por supuesto, éste ha sido el enfoque de la Reserva Federal durante muchos años.

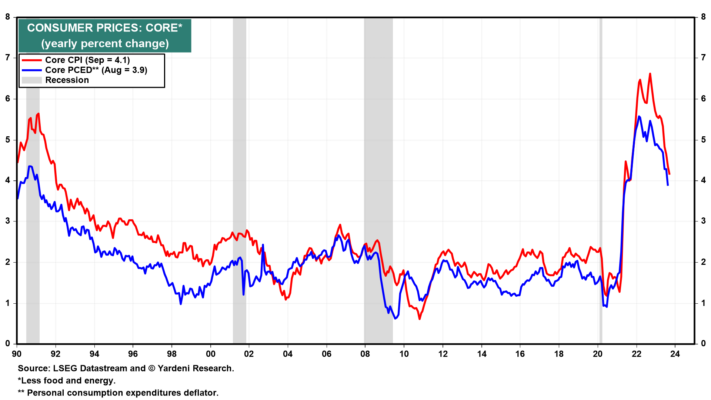

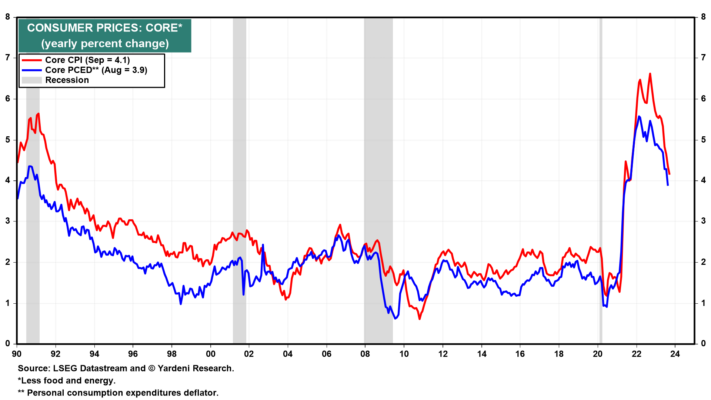

La medida de inflación preferida por la Reserva Federal ha sido la PCED básica, que sigue de cerca al IPC subyacente (Gráfico 1). Este último tiende a superar al primero. Por hoy, nos centraremos en el IPC hasta septiembre, ya que la lectura del PCED de septiembre no se publicará hasta casi finales de mes.

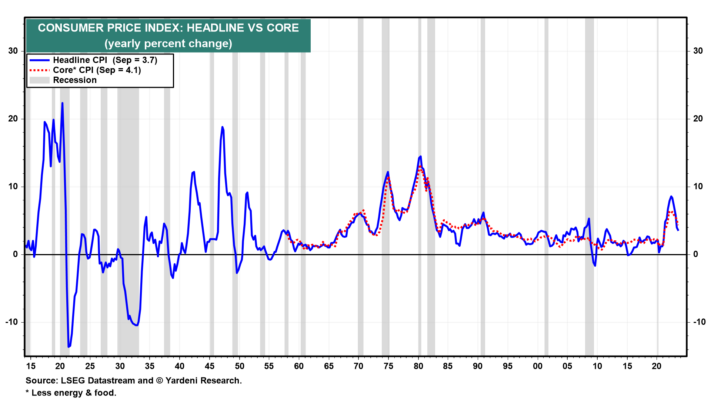

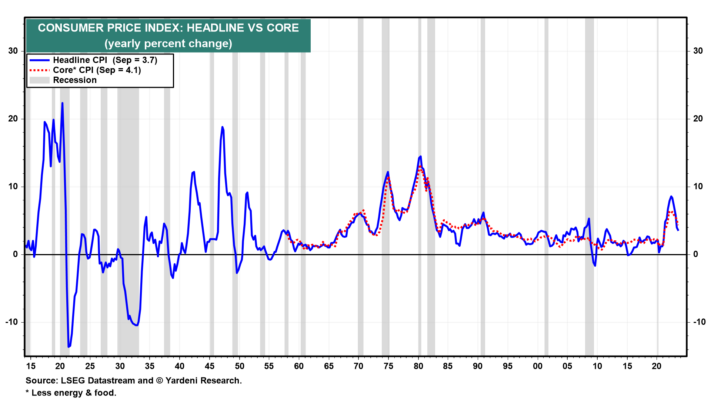

La tasa de inflación general del IPC fue del 3,7% interanual hasta septiembre (Gráfico 2). La tasa subyacente del IPC fue más alta, alcanzando el 4,1%. Ambos están por debajo de sus máximos de 2022 del 9,1% y 6,6%, respectivamente. Pero ambos siguen muy por encima del objetivo del 2,0% de la Reserva Federal.

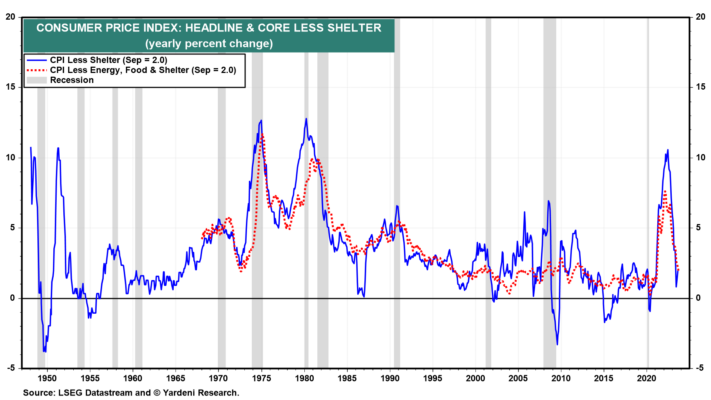

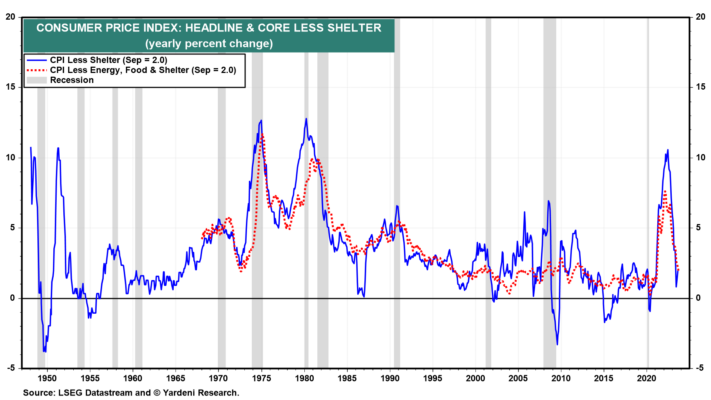

(2) Saliendo del refugio. Antes de continuar, aquí está nuestro chiste: las tasas de inflación general y básica del IPC, excluyendo la vivienda, fueron ambas del 2,0% interanual durante septiembre (Gráfico 3). Entonces, a la pregunta de cuándo llegaremos al objetivo de inflación de la Reserva Federal, la respuesta es que ahora estamos allí excluyendo la vivienda, ¡al menos según la medida del IPC!

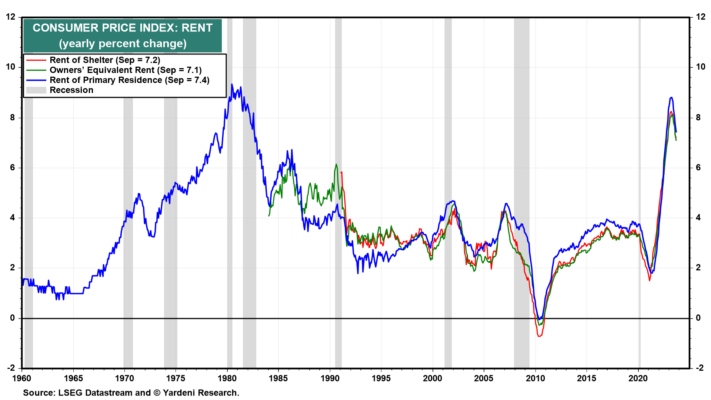

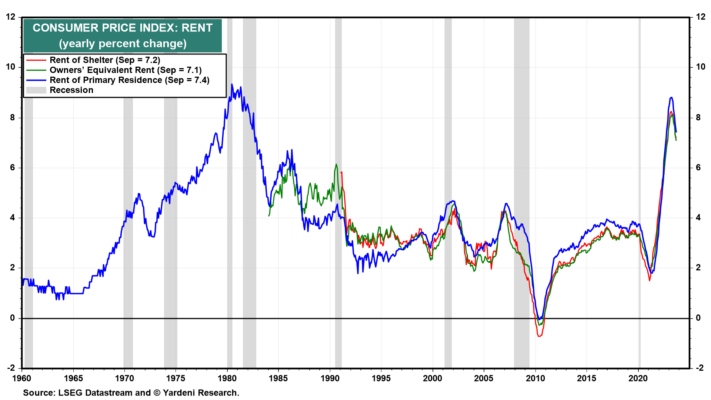

El alquiler de viviendas representa un enorme 34,7% y 43,6% de las medidas generales y básicas del IPC. Su tasa de inflación saltó de un mínimo del 1,5% en febrero de 2021 a un máximo del 8,2% en marzo de 2023 (Fig. 4). En septiembre bajó, pero sólo al 7,2%.

En su discurso, Powell dijo: “Debido a que los arrendamientos se renuevan lentamente, se necesita tiempo para que una disminución en el crecimiento de los alquileres en el mercado se introduzca en la medida general de la inflación. La desaceleración del alquiler en el mercado recién ha comenzado a reflejarse en esa medida. Se puede considerar que la desaceleración del crecimiento de los alquileres para nuevos arrendamientos durante aproximadamente el año pasado está “en proceso” y afectará la inflación medida de los servicios de vivienda durante el próximo año”.

Además, Powell reconoció en su discurso que la inflación de los “alquileres de mercado” (es decir, de nuevos arrendamientos) ha disminuido “constantemente” este año. El índice de alquileres de Zillow bajó al 3,2% interanual durante septiembre. Utilizando esa lectura en lugar de la lectura del IPC sobre el alquiler de viviendas del 7,2 %, Debbie descubrió que el IPC general aumentó solo un 2,3 % frente al 3,7 % del IPC general real.

Según nuestro análisis hasta el momento, en nuestra opinión, el último episodio de inflación está resultando ser transitorio en lugar de persistente. La Reserva Federal podría alcanzar su objetivo del 2,0% para la tasa de inflación básica PCED mucho antes de lo previsto, es decir, en 2024 en lugar de 2025.

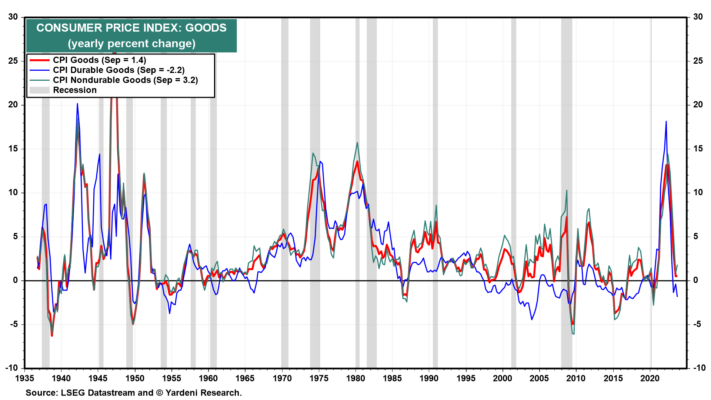

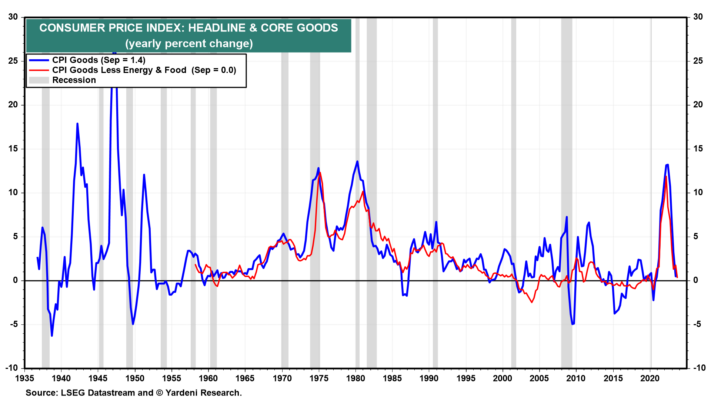

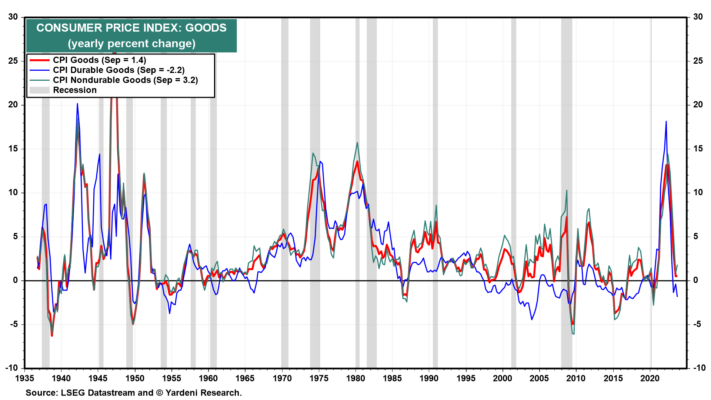

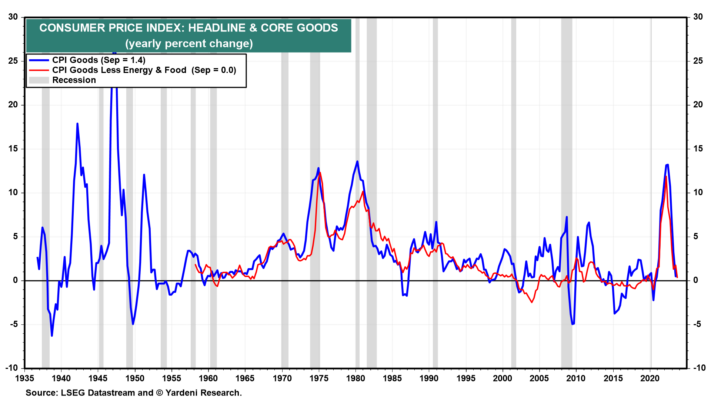

(3) La inflación de bienes es buena. En su discurso, Powell dio a entender que, después de todo, la inflación subyacente de bienes sin duda ha resultado ser transitoria. Dijo: “La inflación de los bienes básicos ha caído drásticamente, particularmente en el caso de los bienes duraderos, a medida que tanto el ajuste monetario como el de la política económica y la lenta corrección de las dislocaciones de la oferta y la demanda lo están haciendo caer”.

Anteriormente explicamos que el atracón de compras de los consumidores después del confinamiento se centró en bienes porque los servicios todavía se veían obstaculizados por las restricciones de distanciamiento social. Eso provocó que la inflación de los bienes aumentara desde aproximadamente cero en el verano de 2020 al 14,0% en 2022 (Fig. 5). Durante septiembre, la inflación de bienes bajó al 1,4%, los bienes duraderos bajaron un 2,2% y los bienes no duraderos aumentaron un 3,2%. Los bienes básicos se mantuvieron sin cambios en septiembre respecto al año anterior (Gráfico 6).

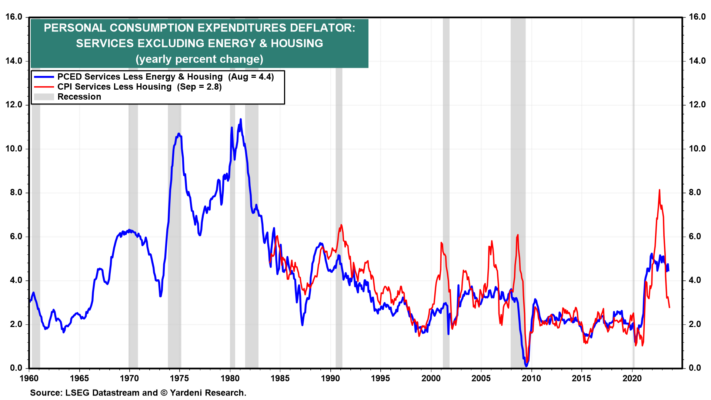

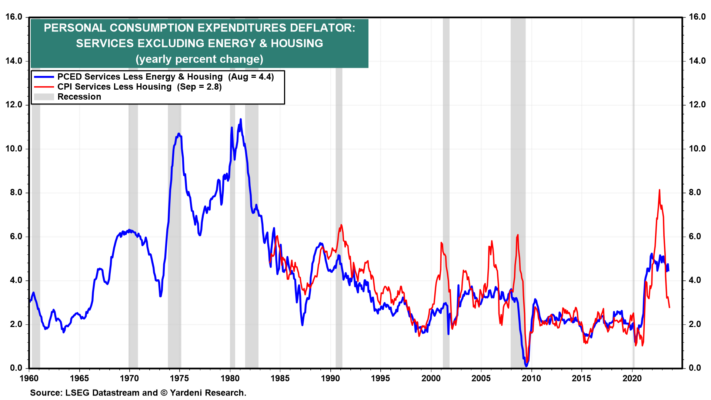

(4) La inflación supercore es persistente. En su discurso, Powell dijo: Para comprender los factores que probablemente impulsen un mayor progreso [en la reducción de la inflación], es útil examinar por separado los tres componentes amplios de la inflación PCE básica: la inflación de bienes, la de servicios de vivienda y la de todos los demás. servicios, a veces denominados servicios no relacionados con la vivienda”. Esta última categoría también se conoce como tasa de inflación “superbásica”. Ha estado estancada en torno al 4,5%-5,0% desde octubre de 2021 (Fig. 7). Sin embargo, la tasa de inflación del IPC de servicios menos vivienda bajó al 2,8% en septiembre desde el máximo del 8,2% del año pasado.

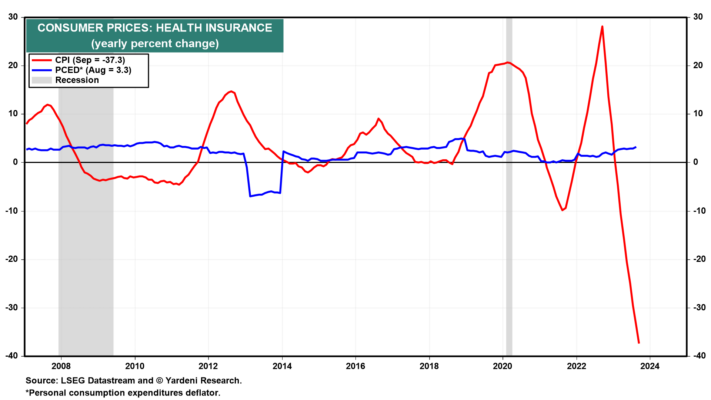

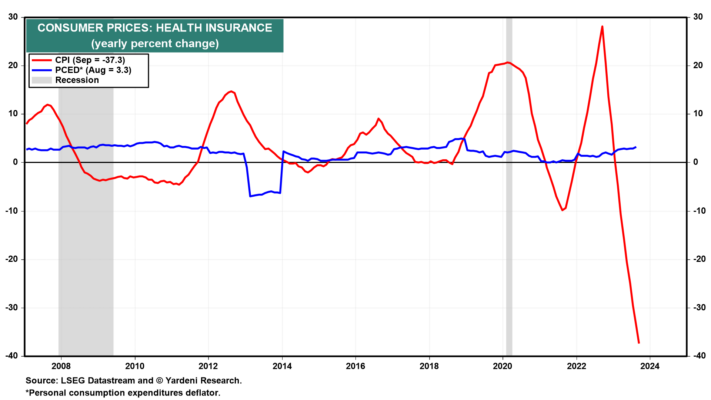

(5) El seguro médico es una locura. Es ampliamente reconocido que el componente de seguro médico del IPC es muy volátil y se basa en una técnica de medición muy cuestionable (Gráfico 8). Mucho más sensata es la medida del seguro médico del PCED, que recientemente se ha mantenido relativamente estable y en un solo dígito en temporalidad interanual, mientras que la medida del IPC ha estado oscilando entre cambios porcentuales interanuales positivos y negativos de dos dígitos. Este último bajó un 37,3% interanual durante septiembre y ahora se espera que regrese a territorio positivo durante los próximos meses.

Todos lo sabemos y nos adaptaremos a esta distorsión. En cualquier caso, tiene un peso minúsculo del 0,545% del IPC.

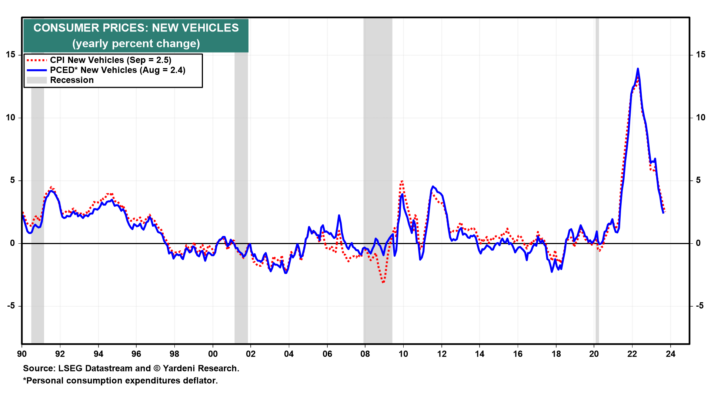

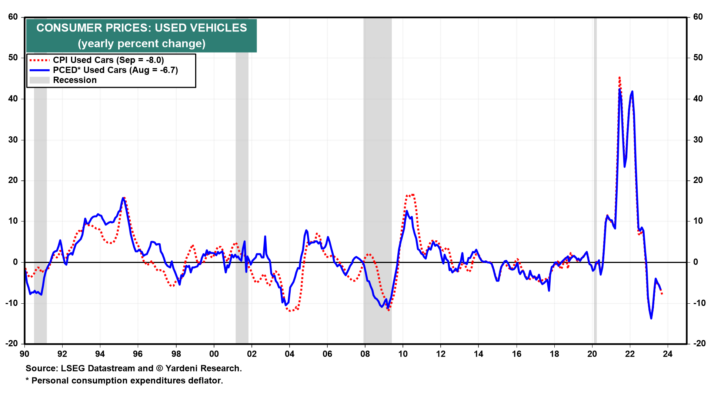

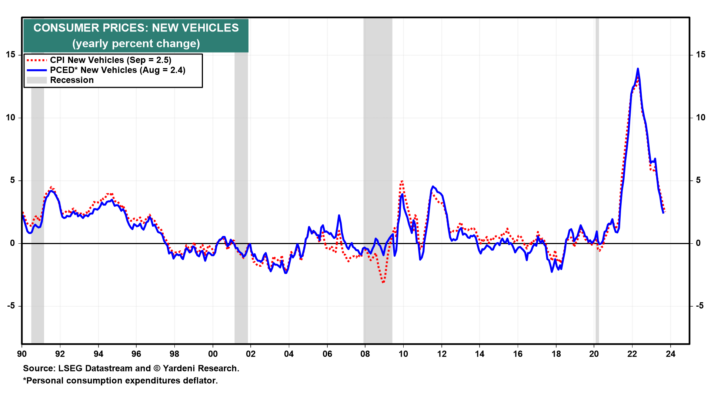

(6) Los precios de los automóviles podrían acelerarse. Los precios de los automóviles nuevos y usados han contribuido a la volatilidad y la naturaleza transitoria de la inflación desde la pandemia. Las interrupciones en la cadena de suministro interrumpieron el suministro de automóviles nuevos desde 2020 hasta la primera mitad de 2022, lo que hizo que los precios de los automóviles nuevos se dispararan. A medida que estos problemas disminuyeron, la tasa de inflación de los precios de los automóviles nuevos se desplomó (Figura 9).

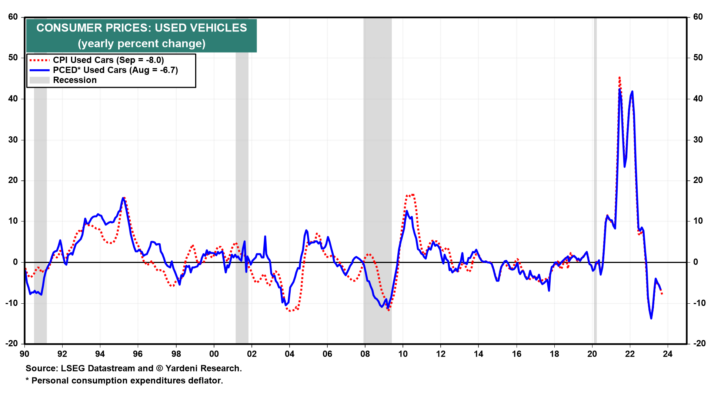

Los precios de los automóviles usados se dispararon incluso más que los precios de los automóviles nuevos durante la pandemia, y los primeros se desplomaron más que los segundos después (Fig. 10). Ahora la preocupación es que la huelga del UAW provoque una escasez de inventarios de automóviles nuevos que una vez más impulse los precios de los automóviles nuevos y usados.

(7) Conclusión. Dicen que el diablo está en los detalles. Es muy posible que eso sea cierto respecto de las perspectivas de inflación. Sin embargo, la inflación suele definirse como un aumento general y relativamente amplio de los precios. En cualquier mes, algunos de los componentes del IPC pueden explicar gran parte del aumento o disminución de ese mes. Lo que importa es la tendencia subyacente. Eso es lo que más buscamos para confirmar nuestra perspectiva o la necesidad de cambiarla. Los últimos datos nos confirman que nuestro escenario sigue por buen camino: la inflación continúa moderándose.

">

">

Una amistad o una relación romántica puede superar muchos altibajos. A veces, durante nuestro dolor, puede parecer que nuestro afecto se ha desvanecido. A menudo, sin embargo, podemos volver a la cercanía porque nuestro dolor nos dice que nos importa. De hecho, las relaciones pueden fortalecerse a partir de períodos de decepción.

Una amistad o una relación romántica puede superar muchos altibajos. A veces, durante nuestro dolor, puede parecer que nuestro afecto se ha desvanecido. A menudo, sin embargo, podemos volver a la cercanía porque nuestro dolor nos dice que nos importa. De hecho, las relaciones pueden fortalecerse a partir de períodos de decepción.

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">

">